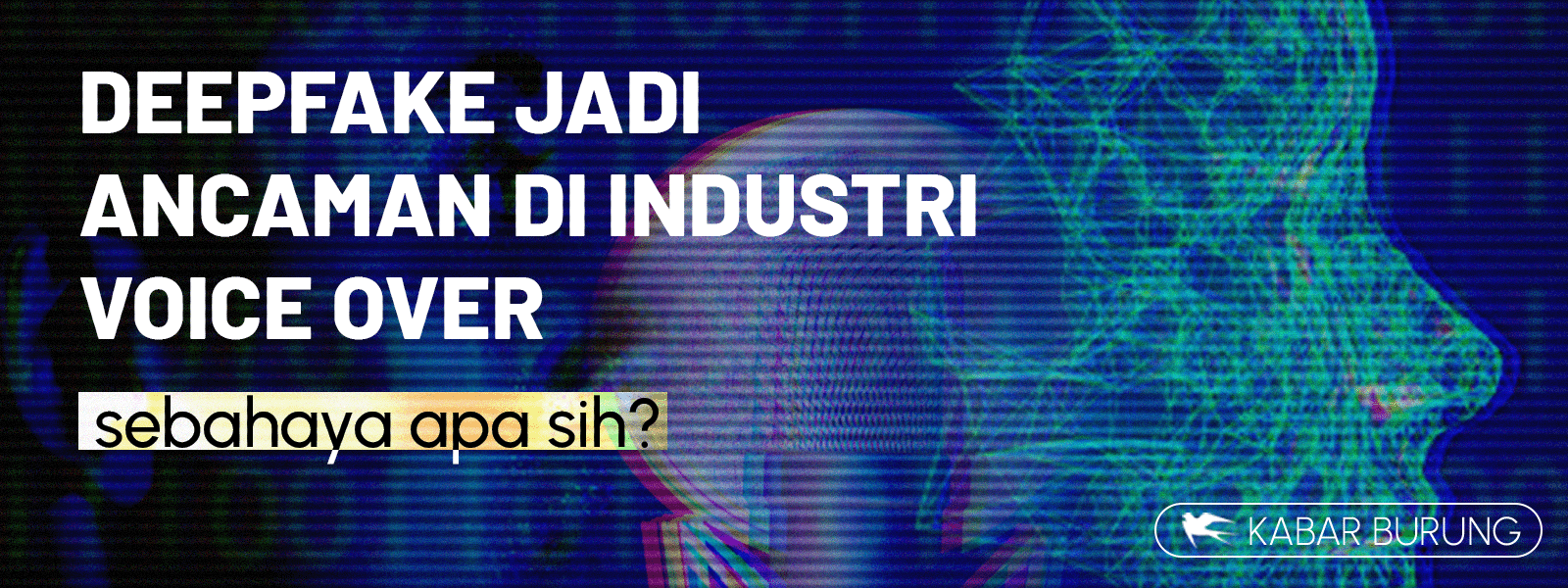

Deepfake Ancam Industri Voice Over, Benarkah Sebahaya Itu?

-

Home

- ›

-

Voice Over Blog

Sudahkah kamu tahu tentang Deepfake yang katanya bisa mengancam industri voice over? Buat orang awam, istilah ini mungkin masih terdengar asing. Tapi bagi para talent, Deepfake jadi momok yang cukup serius. Pasalnya, teknologi ini bisa bikin suara atau wajahmu dipakai tanpa izin, bahkan untuk hal-hal yang merugikan.

Nah, biar kamu gak bingung dan bisa lebih waspada dalam menjaga kariermu di dunia voice over, kali ini kita bakal bahas bareng-bareng tentang apa itu Deepfake, gimana cara kerjanya, seberbahaya apa teknologi itu untuk pengisi suara, sampai aturan hukum yang (harusnya) bisa melindungi kita semua. Yuk, simak sampai akhir!

Deepfake, Teknologi yang Bisa Bikin Konten Palsu Terlihat Nyata

Deepfake sebenarnya bukan teknologi baru. Istilah ini muncul dari gabungan kata deep learning dan fake. Jadi, Deepfake pada dasarnya adalah alat yang digunakan untuk membuat konten palsu menggunakan algoritma kecerdasan buatan alias artificial intelligence (AI).

Awalnya, teknologi ini dikembangkan untuk riset dan hiburan. Misalnya, dipakai buat bikin karakter film lebih realistis, menambahkan efek visual, atau bahkan bikin video edukasi lebih interaktif. Di dunia audio, Deepfake bisa membantu membuat voice cloning, yaitu meniru suara seseorang dengan sangat mirip.

Cara Kerja Deepfake di Dunia VO

Di industri voice over, Deepfake bekerja dengan mengumpulkan data audio seseorang yang ada di internet. Data itu bisa berasal dari podcast, video YouTube, atau iklan lama. Data ini kemudian dianalisis dan dipelajari oleh AI sampai bisa meniru pola bicara, intonasi, bahkan emosi suara.

Hasilnya? Suara yang terdengar hampir 100% mirip dengan suara asli, padahal orang tersebut sama sekali gak ikut rekaman.

Sisi Positif Deepfake

Kalau digunakan dengan benar, Deepfake sebenarnya punya manfaat. Contohnya:

- Efisiensi produksi film atau iklan: Bayangkan aktor yang sudah meninggal masih bisa “hadir” di film lewat suara atau wajahnya. Nah, Deepfake bisa merealisasikannya.

- Aksesibilitas: Deepfake bisa membantu orang dengan disabilitas suara untuk tetap bisa “bicara” dengan teknologi voice cloning.

- Pembelajaran: Di dunia edukasi, Deepfake bisa dipakai untuk membuat simulasi yang lebih hidup sehingga pembelajaran terasa lebih nyata dan menarik untuk para siswa.

Bahaya Deepfake Buat VO Talent

Sayangnya, kalau jatuh ke tangan yang salah, teknologi ini bisa sangat berbahaya. Kasus nyata yang sempat ramai adalah kasus Bimoky (Bimo Kusumo Yudo), salah satu content creator dan pengisi suara Indonesia, yang suaranya dipakai tanpa izin untuk iklan judi online. Suara dan wajahnya dikloning menggunakan Deepfake, lalu dijadikan konten komersial.

Bayangkan kalau hal itu terjadi ke kamu. Suara yang susah payah kamu latih tiba-tiba dipakai untuk hal-hal yang merugikan, bahkan bisa menyeret nama baikmu ke ranah kriminal. Itu bukan cuma masalah uang, tapi juga reputasi dan kepercayaan publik.

Aturan Penggunaan AI: Belajar dari EU AI Act 2024

Di Indonesia, sampai artikel ini ditulis, belum ada aturan spesifik yang mengatur penggunaan AI, termasuk Deepfake. Tapi di Eropa, mereka sudah melangkah lebih maju dengan adanya EU AI Act (2024).

Apa Itu EU AI Act?

EU AI Act adalah regulasi pertama di dunia yang secara khusus mengatur penggunaan AI. Aturan ini dibuat untuk melindungi masyarakat dari potensi penyalahgunaan teknologi, sekaligus tetap memberi ruang inovasi.

Dalam konteks Deepfake, ada beberapa poin penting dari EU AI Act 2024 yang perlu kita pahami:

- Konten Hasil Sintesis Harus Diberi Label: Maksudnya, kalau ada konten (baik suara maupun visual) yang sepenuhnya dibuat oleh AI tanpa tambahan atau perubahan berarti, maka harus diberi keterangan “ini buatan AI”. Transparansi ini penting biar orang gak terkecoh.

- Jika Meniru Orang Nyata, Harus Ada Persetujuan: Deepfake yang meniru wajah atau suara seseorang gak boleh asal pakai. Harus ada izin resmi dari orang yang bersangkutan. Jadi kalau suaramu digunakan untuk konten (entah itu iklan atau konten lainnya), kamu berhak tahu dan memberikan izin atau tidak.

- Melanggar Aturan = Melanggar Hak Privasi: Kalau aturan ini dilanggar, maka dianggap sudah melanggar General Data Protection Regulation (GDPR), yaitu hukum privasi data yang berlaku di Uni Eropa. Hukuman dan denda yang diberikan juga gak main-main.

Dengan regulasi seperti ini, setidaknya ada payung hukum yang jelas. Sayangnya, di Indonesia, perlindungan semacam ini masih belum ada.

Indonesia Butuh Aturan yang Jelas

Di sinilah masalahnya. Tanpa aturan jelas, Deepfake bisa dengan mudah dipakai secara liar di Indonesia. Suara dan wajah kita bisa diambil seenaknya untuk kepentingan komersial, bahkan kriminal.

Kalau hal ini terus dibiarkan, bukan cuma VO talent yang rugi, tapi juga masyarakat luas. Bayangkan kalau Deepfake dipakai untuk penipuan telepon, iklan judi, atau manipulasi politik. Semuanya bisa bikin kekacauan besar!

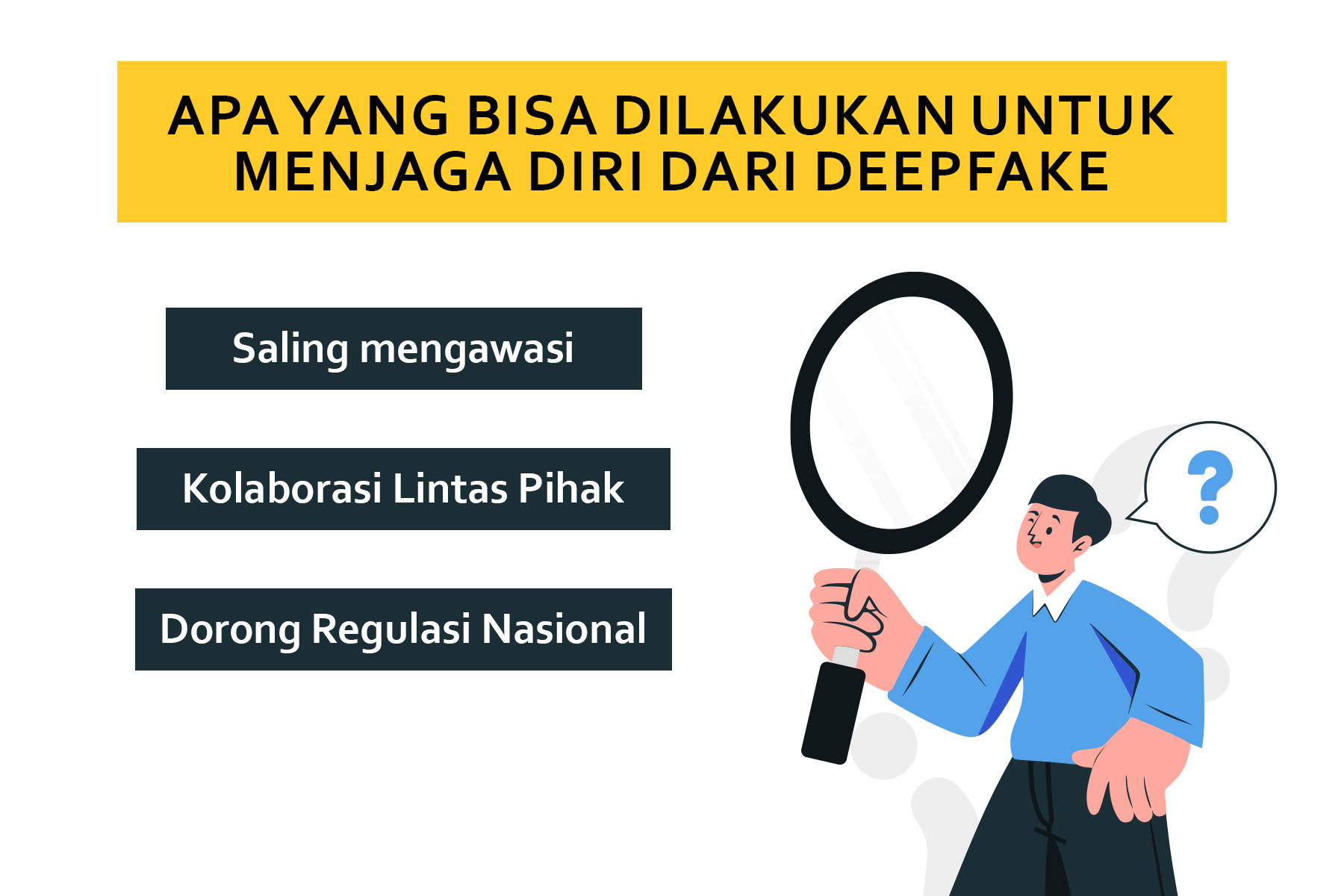

Lalu, apa yang bisa kita lakukan?

- Saling Mengawasi: Kalau kamu menemukan konten Deepfake yang pakai suara atau wajah orang lain untuk tujuan komersial (atau tindakan kriminal) tanpa izin, jangan diam saja! Sebarkan awareness, laporkan ke platform terkait, dan bantu orang tersebut melawan penyalahgunaan.

- Kolaborasi Lintas Pihak: Masalah Deepfake gak bisa dilawan sendirian. Butuh keterlibatan banyak pihak seperti stakeholder, VO talent, course atau training VO, audio post, komunitas, agency, sampai lembaga hukum.

- Dorong Regulasi Nasional: Komunitas VO, agensi, dan masyarakat kreatif harus mulai bersuara agar ada payung hukum di Indonesia. Dengan begitu, suara dan wajah talent bisa dilindungi secara resmi.

Bagaimana Voice Over Talent Bisa Melindungi Diri dari Deepfake?

Teknologi memang gak bisa kita hentikan, tapi ada beberapa langkah praktis yang bisa dilakukan oleh para voice actor agar gak jadi korban Deepfake:

- Batasi Konten Publik: Jangan unggah rekaman suara terlalu panjang atau mentah di media sosial. Semakin banyak data audio yang beredar, semakin mudah AI melatih model untuk menirumu.

- Gunakan Watermark Audio: Sekarang, beberapa pengisi suara profesional mulai menambahkan watermark di file demo mereka. Mirip seperti tanda tangan digital, watermark ini bisa jadi bukti kalau suara itu asli, berasal dari kamu.

- Pantau Konten Online: Rajinlah melakukan pencarian dengan namamu di internet. Kalau menemukan konten Deepfake yang pakai suaramu, segera ambil langkah dengan melaporkannya ke platform, klarifikasi di media sosial, atau hubungi pihak berwenang.

- Bangun Branding yang Kuat: Kalau orang sudah terbiasa dengan gaya khas dan karakter unik suaramu, mereka akan lebih gampang membedakan mana rekaman asli dan mana yang palsu. Jadi, branding bukan cuma buat marketing, tapi juga untuk proteksi.

- Simpan Rekaman Asli: Arsipkan semua rekaman aslimu. Jadi, kalau suatu hari muncul Deepfake yang pakai suara kamu, kamu punya bukti kuat untuk melawan klaim palsu.

Dengan langkah-langkah kecil ini, setidaknya kamu punya tameng tambahan sebelum ada regulasi hukum yang benar-benar kuat di Indonesia.

Intinya, Deepfake memang canggih, tapi kalau gak diatur, bisa jadi ancaman serius buat industri voice over dan industri kreatif. Sebagai voice actor, kamu punya hak untuk melindungi suara dan wajahmu. Karena itu, yuk, sama-sama lebih waspada, saling dukung, dan dorong adanya regulasi yang jelas di Indonesia!

Inavoice, sebagai voice over agency terbaik di Indonesia, percaya bahwa suara itu adalah identitas, karya, dan aset berharga yang harus dijaga. Jadi, jangan sampai teknologi mencuri hak kita!

Always remember, you deserve better.